Sztuczna inteligencja jest dwukrotnie lepsza w wykorzystywaniu błędów w smart kontraktach niż w ich wykrywaniu, wynika z raportu Binance

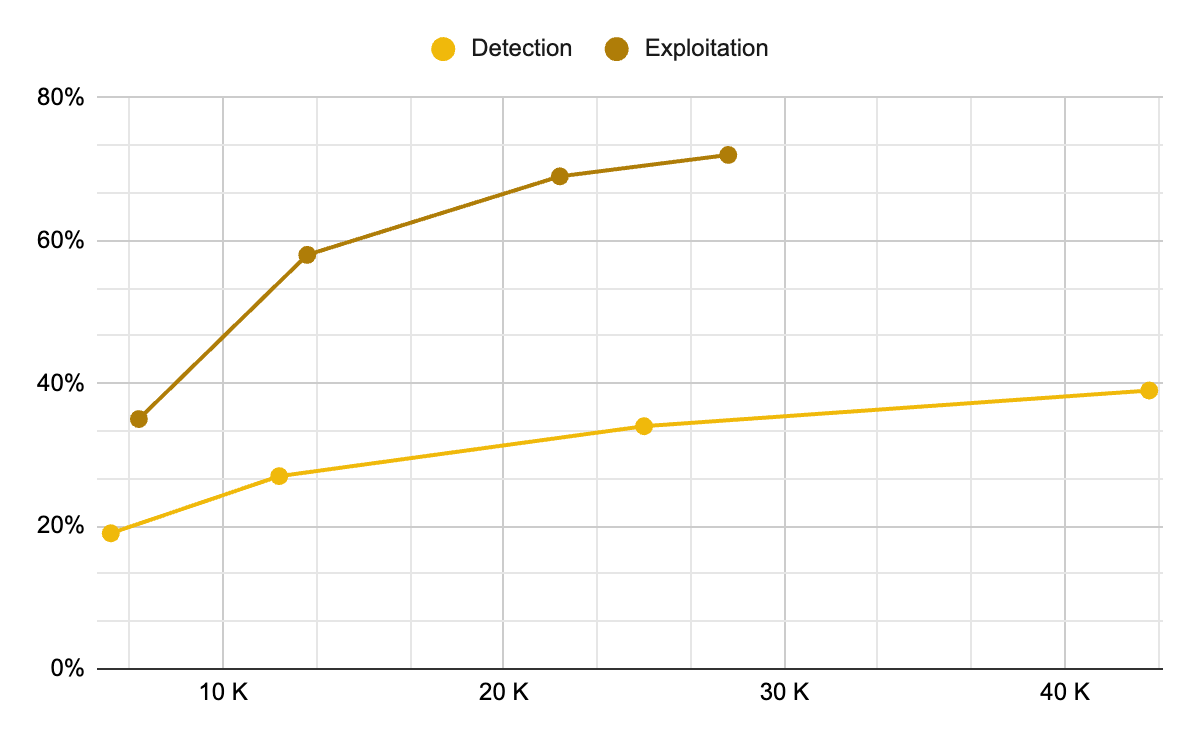

Narzędzia sztucznej inteligencji (AI) wykorzystują obecnie smart kontrakty mniej więcej dwukrotnie skuteczniej niż wykrywają podatności, podaje Binance Research.

Sztuczna inteligencja staje się głównym tematem w dyskusji o atakach na rynek kryptowalut. Wielu analityków coraz częściej podejrzewa, że atakujący wykorzystują te narzędzia do przeprowadzania exploitów DeFi.

Dlaczego różnica między ofensywą a obroną AI się powiększa

W najnowszym raporcie Binance Research zwraca uwagę, że GPT-5,3-Codex osiąga 72,2% skuteczności w trybie „exploitation” na EVMbench. Tymczasem wskaźnik skuteczności w trybie „detection” to niespełna połowa tej wartości.

Możliwości wykrywania i eksploatacji AI. Źródło: Binance

Możliwości wykrywania i eksploatacji AI. Źródło: Binance

Dla kontekstu: EVMbench to narzędzie benchmarkowe, które mierzy, jak dobrze AI potrafi wykrywać, naprawiać i eksploatować krytyczne podatności smart kontraktów. Analizuje 117 wyselekcjonowanych podatności z 40 audytów.

Smart kontrakty przechowują miliardy USD środków użytkowników w zdecentralizowanych finansach (DeFi). Otwartość ich kodu sprawia, że idealnie nadają się do automatycznych ataków. Systemy AI mogą skanować tysiące kontraktów w kilka minut przy minimalnych kosztach.

Przewaga rośnie, ponieważ koszty ataku gwałtownie spadają. Według danych Binance Research średni koszt exploita z użyciem AI to około 1,22 USD za kontrakt, a prognozy mówią o spadku tej kwoty o kolejne 22% co dwa miesiące.

Zagrożenie wykracza poza statyczny kod. Analitycy TRM Labs zaczynają podejrzewać, że północnokoreańscy hakerzy integrują AI w działaniach rekonesansowych oraz socjotechnicznych.

Takie podejście może tłumaczyć ataki jak Drift, gdzie tygodniami manipulowano zaawansowanymi systemami blockchain. To duża zmiana względem dotychczasowych ataków Korei Północnej, które polegały na prostym przejęciu kluczy prywatnych.

Obserwuj nas na X, by otrzymywać najnowsze wiadomości na bieżąco

AI zmienia ekonomię oszustw w kryptowalutach

Ekonomia oszustw internetowych również zmieniła się radykalnie. Chainalysis ustaliło, że oszustwa z użyciem AI przynoszą 4,5 razy więcej środków na każdy przypadek niż tradycyjne i generują dziewięć razy większą aktywność transakcyjną.

Firma odnotowała, że wzrost wolumenu transakcji wskazuje na to, iż AI pozwala oszustom dotrzeć do znacznie większej liczby ofiar jednocześnie. To cecha oszustw prowadzonych na skalę przemysłową.

Oszustowie coraz częściej korzystają z technologii deepfake oraz wygenerowanych przez AI treści do przygotowywania przekonujących podszyć przy oszustwach matrymonialnych i inwestycyjnych. W 2025 liczba ataków bazujących wyłącznie na podszywaniu wzrosła rok do roku aż o 1400%.

Około 60% ankietowanych z branży zauważa, że rosnące wykorzystanie AI przez przestępców to główny czynnik wzrostu ryzyka w 2025. Kryptowaluty są szczególnie narażone. Branża odpowiada za 88% wszystkich wykrytych przypadków oszustw deepfake na świecie.

Zasubskrybuj nasz kanał YouTube, by zobaczyć ekspertów i dziennikarzy komentujących bieżące wydarzenia

BeInCrypto Polska - Sztuczna inteligencja jest dwukrotnie lepsza w wykorzystywaniu błędów w smart kontraktach niż w ich wykrywaniu, wynika z raportu Binance

Możesz także polubić

Zdecentralizowane platformy odebrały udział CEX-om w kwartale o ograniczonym ryzyku, jak ustaliło ARK Invest

Napływy do Bitcoin ETF pozostają silne, a BNB sygnalizuje wybicie